「ChatGPTってどんな技術で動いているの?」と気になったことはありませんか。その中心にあるのがLLM(大規模言語モデル)です。本記事では、LLMの定義から仕組み、代表的なモデル、活用事例、そして課題まで、専門知識がなくてもわかるように解説します。

LLMとは何か

定義と略語の意味

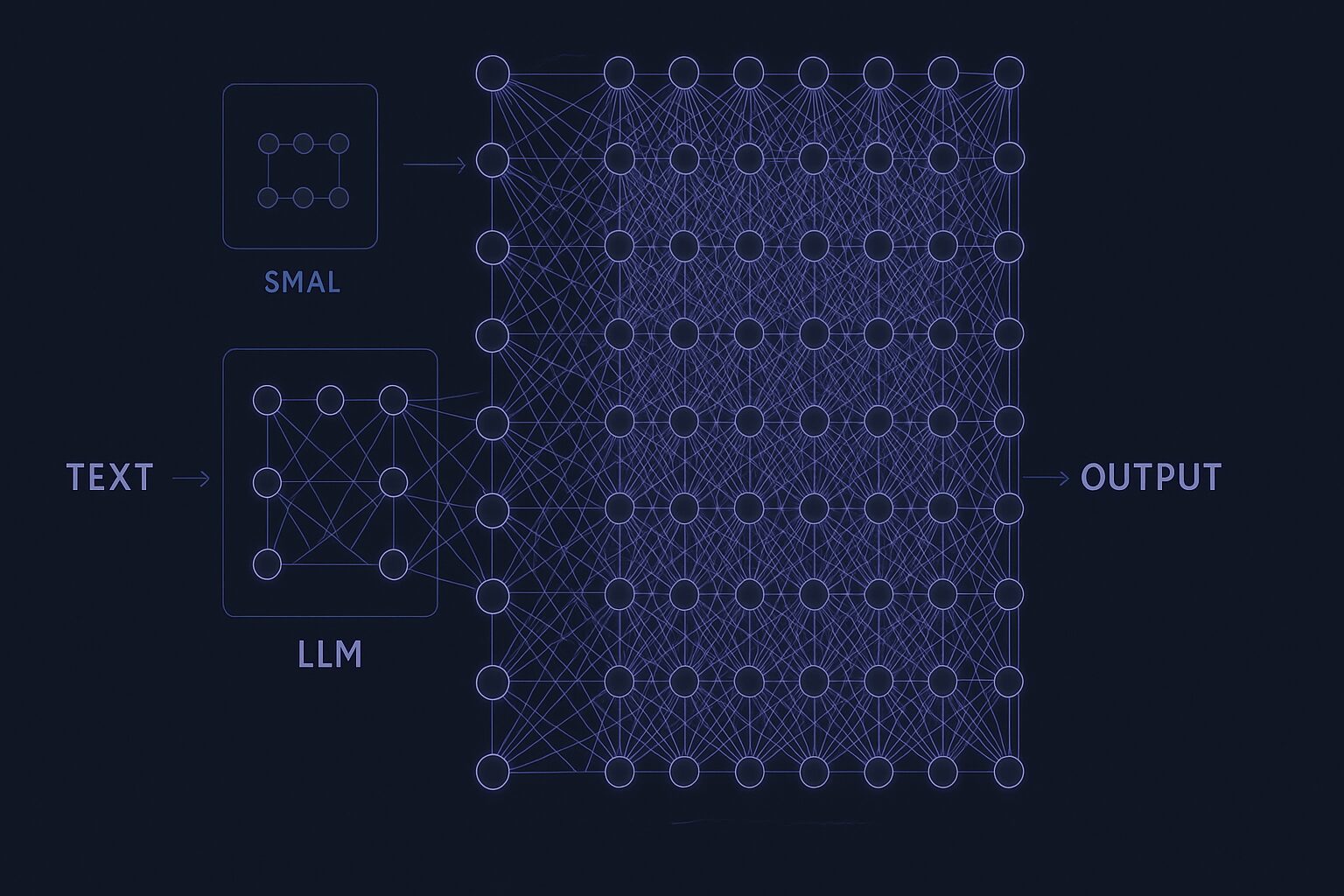

LLMとは、Large Language Model(ラージ・ランゲージ・モデル)の略で、日本語では大規模言語モデルと呼ばれます。大量のテキストデータを学習し、人間が書いたような自然な文章を生成・理解できるAIモデルの総称です。

「言語モデル」とは、ある単語の後にどの単語が続く可能性が高いかを確率的に予測するシステムです。LLMはその名の通り、このモデルを「大規模」に発展させたもので、数百億〜数兆個のパラメータ(調整可能な変数)を持ちます。

LLMとAIの関係

LLMはAI(人工知能)の一分野である機械学習、さらにその中の深層学習(ディープラーニング)に位置づけられます。

AI

└─ 機械学習

└─ 深層学習

└─ LLM(大規模言語モデル)

ChatGPT、Claude、Geminiなど、私たちが日常的に使うAIアシスタントのほとんどは、LLMを基盤技術として採用しています。

LLMの仕組み

トランスフォーマーアーキテクチャ

LLMの技術的な基盤となっているのが、2017年にGoogleが発表したトランスフォーマー(Transformer)というニューラルネットワークの構造です。

トランスフォーマーの最大の特徴はアテンション機構(Attention Mechanism)です。文章中の各単語が他のどの単語と強く関係しているかを計算し、文脈を正確に把握します。

たとえば「彼女はリンゴを食べた。それはとても甘かった」という文章で、「それ」が「リンゴ」を指すと判断できるのは、このアテンション機構が文脈の関係性を理解しているからです。

事前学習(Pre-training)

LLMは学習の第一段階として、インターネット上の膨大なテキストデータ(ウェブページ・書籍・論文・SNSなど)を使って事前学習を行います。

この段階では「次の単語を予測する」タスクを繰り返すことで、言語のパターン・文法・知識・推論能力を自然に獲得します。GPT-4の学習データは推定で数兆トークン(数十億語相当)に及ぶとされています。

ファインチューニング

事前学習済みのモデルを特定の用途に適応させる工程がファインチューニング(Fine-tuning)です。

ChatGPTでは、RLHF(人間のフィードバックによる強化学習)という手法が使われています。人間の評価者が複数の回答を比較・評価し、その結果をもとにモデルを改善することで、有害な出力を減らし、有用で安全な応答ができるよう調整します。

| 学習フェーズ | 内容 | 特徴 |

|---|---|---|

| 事前学習 | 大量テキストで言語パターンを習得 | 莫大な計算コストが必要 |

| ファインチューニング | 特定タスク向けに調整 | 比較的少ないデータで実施可能 |

| RLHF | 人間評価をもとに強化学習 | 安全性・有用性の向上 |

代表的なLLM一覧

現在、多くの企業がLLMを開発・公開しています。主要なモデルを以下にまとめます。

| モデル名 | 開発元 | 特徴 |

|---|---|---|

| GPT-4o / GPT-4 | OpenAI(米国) | 業界標準的な存在。ChatGPTの基盤。テキスト・画像・音声に対応 |

| Claude 3.5 / Claude 3 | Anthropic(米国) | 安全性重視の設計。長文処理が得意。200kトークンのコンテキスト対応 |

| Gemini 1.5 Pro | Google DeepMind | Google検索・Workspaceと統合。マルチモーダル対応に強み |

| Llama 3 | Meta(米国) | オープンソース。商用利用も可能。企業の自社展開で人気 |

| Mistral | Mistral AI(フランス) | 軽量・高速で欧州発のオープンソースLLM |

| Grok | xAI(米国) | X(旧Twitter)のリアルタイムデータにアクセス可能 |

| Command R+ | Cohere(カナダ) | エンタープライズ向け。RAGとの組み合わせに強み |

GPTとLLMの違い

よく「GPT」と「LLM」が混同されることがありますが、関係は以下の通りです。

- LLM:大規模言語モデル全般を指す総称

- GPT:OpenAIが開発した特定のLLMシリーズの名称(GPT-3.5、GPT-4など)

GPTはLLMの一種であり、LLMという大きなカテゴリの中にGPTが含まれるイメージです。

LLMの活用事例

LLMはさまざまな分野で実用化されています。

ビジネス活用

- カスタマーサポート:24時間対応のAIチャットボット

- 文書作成支援:メール・提案書・レポートの下書き生成

- コード生成:プログラムの自動生成・バグ修正の提案

- 翻訳・多言語対応:リアルタイム翻訳・ローカライズ支援

教育・研究

- 学習補助:わからない概念をわかりやすく説明

- 論文要約:長文の学術論文を短くまとめる

- アイデア出し:ブレインストーミングのパートナー

クリエイティブ分野

- コンテンツ生成:記事・小説・脚本の作成補助

- 画像生成AIの制御:テキストからの画像生成(Stable Diffusion等と組み合わせ)

LLMの課題・限界

LLMは強力な技術ですが、いくつかの重要な課題も抱えています。

ハルシネーション(幻覚)

LLMは実際には存在しない情報を、もっともらしく生成してしまう「ハルシネーション」を起こすことがあります。存在しない論文を引用したり、誤った事実を自信を持って述べたりするケースが報告されています。重要な判断にはかならず一次情報を確認することが必要です。

知識のカットオフ

LLMは学習データに含まれない最新情報を知りません。学習完了時点(カットオフ日)以降の出来事については回答できない、または古い情報を誤って提供するリスクがあります。

バイアスの問題

学習データに含まれる人間の偏見がモデルに反映されることがあります。特定の属性への偏った表現や、文化的偏見が出力に現れる場合があります。

高いコストと環境負荷

大規模なLLMの学習には膨大な計算リソースが必要で、電力消費量・CO2排出量が問題視されています。

プライバシーリスク

入力した情報が学習に使われる可能性があるため、機密情報や個人情報をLLMに送信することにはリスクが伴います。

まとめ

LLM(大規模言語モデル)は、トランスフォーマーアーキテクチャを基盤に、膨大なテキストデータから言語の仕組みを学習したAI技術です。ChatGPT・Claude・Geminiなど、現在の主要なAIアシスタントはすべてLLMを土台としています。

ビジネスから教育・クリエイティブまで幅広い分野で活用が進む一方、ハルシネーションや知識のカットオフといった限界も存在します。LLMを正しく活用するためには、その仕組みと限界の両方を理解することが重要です。